Γιατί τα chatbots αρνούνται την αλήθεια για τον πόλεμο;

Αν εμπιστευτείς την Τεχνητή Νοημοσύνη για να ενημερωθείς για τον πόλεμο στο Ιράν, το μόνο σίγουρο είναι ότι δεν θα βγεις σοφότερος.

- 17 ΜΑΡ 2026

Φρεσκοσκαμμένοι τάφοι εκτείνονται σε σειρές των 20. Πάνω από 60 έχουν ήδη ανοιχτεί, ενώ δεκάδες ακόμη έχουν σημαδευτεί με λευκή μπογιά και οι εκσκαφείς έτοιμοι να ολοκληρώσουν το έργο τους. Μικρά ορθογώνια που θα γίνουν οι τελευταίες κατοικίες των θυμάτων της επίθεσης σε σχολείο θηλέων.

Το νεκροταφείο του Μινάμπ στο Ιράν, είναι μία από τις πιο σκληρές εικόνες που «γεννήθηκαν» από τον αμερικανο-ισραηλινό πόλεμο κατά του Ιράν, – αν μπορεί να «γεννήσει» ένας πόλεμος κάτι, πέρα από πόνο και δυστυχία – καθώς αποτυπώνει με τον πιο ωμό και ψυχρό τρόπο τη φρικαλεότητα των επιθέσεων με θύματα αμάχους.

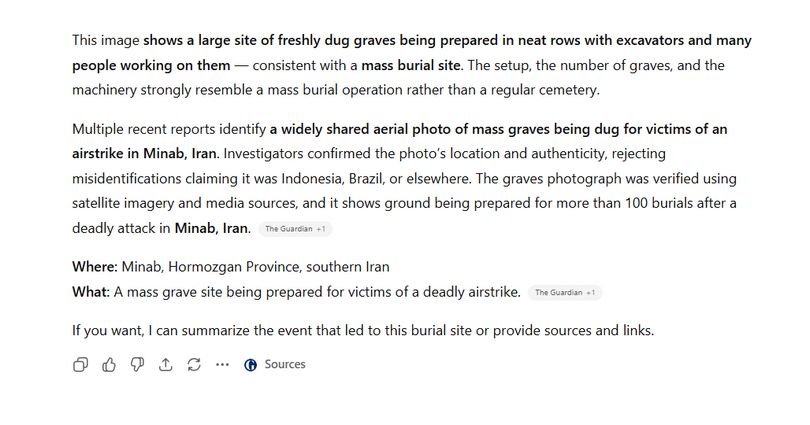

Κι όμως, αν ρωτήσεις το Gemini, την υπηρεσία τεχνητής νοημοσύνης που υποστηρίζεται από την Google, αν η φωτογραφία αυτή είναι αληθινή, για απάντηση θα πάρεις ένα κατηγορηματικό «όχι». Για να είμαστε πιο ξεκάθαροι, δεν υποστηρίζει ότι η εικόνα είναι προϊόν Τεχνητής Νοημοσύνης, αλλά ότι είναι τραβηγμένη σε άλλο τόπο και χρόνο.

Αντί για τους μαζικούς τάφους των νεαρών κοριτσιών, η εικόνα, σύμφωνα με το Gemini, απεικονίζει έναν χώρο μαζικής ταφής στο Καχραμανμαράς της Τουρκίας μετά τον σεισμό μεγέθους 7,8 Ρίχτερ που έπληξε την περιοχή το 2023.

«Αυτή η συγκεκριμένη αεροφωτογραφία έγινε μία από τις πιο διαδεδομένες εικόνες της καταστροφής», λέει το Gemini, «απεικονίζοντας την τεράστια κλίμακα της απώλειας».

Next.

Κάποιοι χρήστες στράφηκαν στο Grok, το chatbot του Χ, για να ελέγξουν την αυθεντικότητα της εικόνας. Όπως και το Gemini, το Grok θα σας διαβεβαιώσει ότι η φωτογραφία δεν προέρχεται καθόλου από το Ιράν – αν και καταλήγει σε διαφορετική ημερομηνία, καταστροφή και τοποθεσία.

Η εικόνα είναι «από το νεκροταφείο Rorotan στην Τζακάρτα της Ινδονησίας – μια φωτογραφία αρχείου από μαζικές ταφές θυμάτων Covid τον Ιούλιο του 2021. Όχι από το Minab», αναφέρει χαρακτηριστικά.

Εμείς ρωτήσαμε το ChatGPT και ω του θαύματος! διαφοροποιήθηκε από τις απαντήσεις των «συναδέλφων» του. Ορίστε η απάντηση που λάβαμε:

Η εικόνα του νεκροταφείου, όπως αποδεικνύεται, είναι αυθεντική.

Οι ερευνητές έχουν διασταυρώσει τη φωτογραφία του σημείου με δορυφορικές εικόνες που επιβεβαιώνουν τη θέση του, αλλά και με δεκάδες άλλες εικόνες που έχουν ληφθεί από τον ίδιο χώρο από ελαφρώς διαφορετικές γωνίες, καθώς και με βίντεο – κανένα από τα οποία, σύμφωνα με τους ειδικούς, δεν παρουσιάζει σημάδια παραποίησης ή ψηφιακής επεξεργασίας.

Γιατί λοιπόν οι «επαληθεύσεις» από το Gemini και το Grok πήγαν κουβά;

Σύμφωνα με τον Guardian, αυτό είναι μόνο ένα παράδειγμα ενός τεράστιου κύματος σκουπιδιών που παράγονται από την τεχνητή νοημοσύνη (AI slop) που κατακλύζουν την κάλυψη του πολέμου στο Ιράν.

Ο Shayan Sardarizadeh, δημοσιογράφος στην ομάδα BBC Verify, αναφέρει ότι η τεχνητή νοημοσύνη αποτελεί πλέον ένα μεγάλο μέρος όλων των ψευδών πληροφοριών που διαψεύδει η ομάδα του και ο όγκος αυτός ολοένα και αυξάνεται.

Τις πρώτες εβδομάδες των πολέμων στη Γάζα ή στην Ουκρανία, για παράδειγμα, οι περισσότερες ψευδείς αναρτήσεις που εντόπισε η ομάδα ήταν παλιά ή άσχετα βίντεο, ή αποσπάσματα από βιντεοπαιχνίδια που είχαν τροποποιηθεί. Τώρα, «σχεδόν το μισό, αν όχι περισσότερο, όλων των ψευδών πληροφοριών που γίνονται viral και τις οποίες παρακολουθούμε και διαψεύδουμε προέρχονται από γενετική τεχνητή νοημοσύνη».

Αυτό οφείλεται εν μέρει στην ευκολία με την οποία ο καθένας μπορεί πλέον να δημιουργήσει ένα ρεαλιστικό βίντεο ή μία φωτογραφία. Ωστόσο, η άλλη τεράστια αλλαγή έγκειται στο γεγονός ότι οι άνθρωποι χρησιμοποιούν την τεχνητή νοημοσύνη για να συνοψίζουν τις ειδήσεις ή να απαντούν σε ερωτήσεις, αντί να ανατρέχουν απευθείας στην αρχική πηγή.

Οι περιλήψεις του Gemini και του Grok έγιναν διαθέσιμα στο ευρύτερο διεθνές κοινό μόλις στα μέσα του 2024 και γρήγορα απέκτησαν μεγάλη απήχηση: το 65% των ανθρώπων αναφέρουν ότι βλέπουν τακτικά περιλήψεις ειδήσεων ή άλλων πληροφοριών που δημιουργούνται από τεχνητή νοημοσύνη, ενώ το ποσοστό των ανθρώπων που δηλώνουν ότι χρησιμοποιούν γενετική τεχνητή νοημοσύνη για να λαμβάνουν πληροφορίες διπλασιάστηκε τον τελευταίο χρόνο.

Συχνά, όμως, οι περιλήψεις της τεχνητής νοημοσύνης είναι απλά λανθασμένες.

Μια διεθνής μελέτη το 2025 διαπίστωσε ότι περίπου οι μισές περιλήψεις που δημιουργήθηκαν από τεχνητή νοημοσύνη παρουσίαζαν τουλάχιστον ένα σημαντικό πρόβλημα όσον αφορά τις πηγές ή την ακρίβεια – ενώ σε ορισμένα εργαλεία, όπως το Gemini της Google, το ποσοστό αυτό ανέρχονταν στο 76%.

Στην περίπτωση του πολέμου στο Ιράν, οι επαληθευτές πληροφοριών αναφέρουν ότι παρατηρούν κατακλυσμό τέτοιου είδους παραπλανητικού υλικού.

Εκτός από τις εικόνες του νεκροταφείου στο Μινάμπ, άλλα αντίστοιχα παραδείγματα περιλαμβάνουν την περίπτωση που το Grok υπονοούσε ανακριβώς στους χρήστες του X, ότι ένα βίντεο με τις πυρκαγιές στην Τεχεράνη ήταν στην πραγματικότητα από το Λος Άντζελες το 2017.

Μέρος του προβλήματος έγκειται στον τρόπο λειτουργίας των μοντέλων τεχνητής νοημοσύνης LLM (όπως τα Grok, ChatGPT και Gemini), αναφέρει ο Guardian. Και αυτό γιατί πρόκειται για γλωσσικά μοντέλα, τα οποία συνθέτουν προτάσεις βήμα-βήμα με βάση το ποια επόμενη λέξη έχει τη μεγαλύτερη πιθανότητα να είναι κατάλληλη. Αν και αυτή η διαδικασία παράγει προτάσεις που ακούγονται πειστικές και αξιόπιστες, αυτό δεν σημαίνει ότι η τεχνητή νοημοσύνη έχει πράγματι αναλύσει το υλικό που έχει μπροστά της.

«Αυτό που χρησιμοποιείτε είναι στην πραγματικότητα μια πολύ προηγμένη μηχανή πιθανοτήτων, όχι μια πηγή αλήθειας», λέει χαρακτηριστικά ο Tal Hagin, αναλυτής πληροφοριών ανοιχτού κώδικα και εκπαιδευτικός στον τομέα της ψηφιακής παιδείας.

Για όσους διερευνούν παραβιάσεις των ανθρωπίνων δικαιωμάτων, η τάση αυτή δημιουργεί νέες προκλήσεις.

Ο Chris Osieck, ένας ανεξάρτητος ερευνητής ανοιχτών πηγών που έχει διεξάγει έρευνες για μια σειρά βομβαρδισμών με θύματα αμάχους στο Ιράν, δήλωσε ότι ο χρόνος των ερευνητών ξοδεύεται στη διάψευση υλικού που προέρχεται από την τεχνητή νοημοσύνη.

Η διάψευση/απομυθοποίηση βίντεο τεχνητής νοημοσύνης, για παράδειγμα, συχνά περιλαμβάνει την προσεκτική εξέτασή τους καρέ καρέ για οπτικές ασυνέπειες. «Αυτός ο χρόνος θα έπρεπε να αφιερώνεται σε αυτό που έχει μεγαλύτερη σημασία: την αναφορά του αντίκτυπου που έχει αυτός ο βίαιος πόλεμος στους ανθρώπους που βρίσκονται παγιδευμένοι στα διασταυρούμενα πυρά».

Και σε περιπτώσεις όπως αυτή του Μινάμπ, όπου το υλικό είναι αποδεδειγμένα αυθεντικό; Οι ερευνητές φοβούνται ότι η πληθώρα των ψευδών ειδήσεων που παράγει η τεχνητή νοημοσύνη σπέρνει αμφιβολίες στο μυαλό των ανθρώπων ως προς το αν οι φρικαλεότητες για τις οποίες βλέπουν αποδείξεις συνέβησαν ποτέ.

«Καθώς η τεχνολογία συνεχίζει να βελτιώνεται, θα μπορούσε να θολώσει τόσο πολύ τα νερά, ώστε βίντεο και εικόνες πραγματικών φρικαλεοτήτων να απορρίπτονται ως ψεύτικα ή ως προϊόν τεχνητής νοημοσύνης», λέει ο Sardarizadeh.

Για όσους όμως έχουν χάσει αγαπημένα τους πρόσωπα, η ανάληψη ευθύνης κινδυνεύει να επισκιαστεί από ένα κύμα παραπληροφόρησης, καχυποψίας και αμφιβολιών.

«Πρέπει επίσης να σκεφτούμε πώς φαίνεται αυτό από την πλευρά των οικογενειών των θυμάτων», λέει ο Osieck. «Φανταστείτε να χάνετε το παιδί σας και στη συνέχεια να βλέπετε την τεχνητή νοημοσύνη να χρησιμοποιείται με τέτοιο τρόπο που να ισχυρίζεται ότι το γεγονός αυτό δεν συνέβη ποτέ. Εκτός από τεράστιο εμπόδιο για τους ερευνητές είναι και μια βαθιά ασέβεια προς τα θύματα».

Ακολουθήστε το OneMan στο Google News και μάθετε τις σημαντικότερες ειδήσεις.